文 | 德福

排除那些精確到小數點後兩位的自動駕駛的代際數之外,目前國內最能讓我感到“有意思”的自動駕駛技術,就是昨天第二屆百度Apollo生態大會上百度Apollo的L4級純視覺感知解決方案——Apollo Lite。

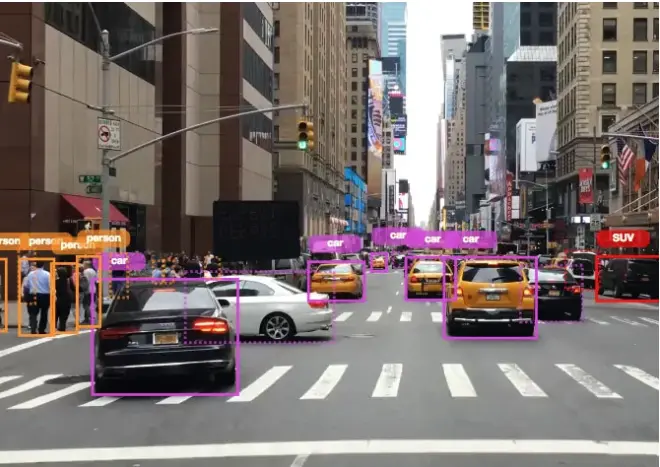

先按下L幾這個對於消費者非常直觀的自動駕駛指標不表,整件事中最有意思的部分就是百度解決自動駕駛解決方案的核心方式:純視覺。用百度自己的話來說,就是這套解決方案是通過對10路攝像頭、200幀/秒數據量的並行處理,單視覺鏈路最高丟幀率能夠控制在5‰以下,實現全方位360°實時環境感知,前向障礙物的穩定檢測視距達到240米。

依靠這套感知系統,百度無人車可以在城市道路上實現不依賴高線數旋轉式激光雷達的端到端閉環自動駕駛——並且已經在北京稻香湖等多地多路段落地測試。

聽上去感覺很美妙對不對?畢竟僅用常識來思考,10個攝像頭的成本再高,也高不過那車頂上旋轉式激光雷達。但問題來了,為什麼在主流的自動駕駛技術企業中,目前只有特斯拉選擇了純視覺的解決方式?又是什麼原因能讓馬斯克曾破口大罵:“用激光雷達做自動駕駛的都是傻X”,得罪了幾乎全部的同行?

偉大航路的殊途

卻未必能實現同歸

自打2014年,SAE International(國際汽車工程師協會)制訂了一套自動駕駛汽車分級標準,其對自動化的描述分為5個等級開始。就如同海賊王羅傑在處刑臺上喊出他的所有財寶都埋藏在偉大航路終點,引發了“大海賊時代”一樣。眾多志在實現自動駕駛的企業紛紛挑明旗幟,立志成為最先到達“ONE PIECE”的人。

結果呢,2018年的時候,長時間內都是自動駕駛領頭羊的企業Waymo CEO John Krafcik在一次技術大會上親口承認,L5級別的自動駕駛真的很難,人類距離在任何天氣任何情況下的自動駕駛可能還需要幾十年。又讓所有對於自動駕駛抱有期許的人陷入了萬古如長夜的灰暗。

而其中牽絆住人類腳步的很重要的原因,就是算法。

無數在圖像算法上傾盡畢生所學的專家們悲哀地發現,當我們將圖像的幾個像素改變時,算法輸出的結果就大不同。並且,網絡越深,我們就越能看到這些失敗的泛化。

2016年,特斯拉一輛Model S車追尾白色拖車,導致駕駛員喪生。當時特斯拉官方稱,拖車側面是白色的,在太陽強光的照射下導致駕駛者和自動駕駛系統都沒有注意到這輛拖車。

兩年之後,Uber的自動駕駛車撞上了一名過馬路的女子,後期的調查報告顯示,自動駕駛軟件先是錯誤地將該女性識別為一個未知物體,然後是一輛車,最後是一輛自行車,最終女子被撞身亡。

自動駕駛不能普及的另一個原因被蘋果聯合創始人Steve Wozniak指了出來:“道路是由人類建造的,人類是不完美的,而且汽車目前無法解釋這一因素。”

原因聽起來很可笑對吧?但事實卻很可能正是如此。百年來我們所建立的現代道路規劃以及基礎設施,完全都是因為我們人類的使用習慣所設。

而機器所需要的是更加純粹、更加準確、更加符合機器使用習慣的環境。這就像是為什麼羅永浩那基於劃時代的語音輸入系統打造出來的TNT,理應讓我們輸入方式更加輕鬆,但我依然在用鼠標鍵盤來寫這篇文章,而羅老師在上演真還傳。(真的是在哪都能拉羅老師出來敲打一番)

那既然我們沒法改變道路現狀的事實成立,有沒有另一條路通向自動駕駛的“ONE PIECE”呢。激光雷達便是這樣一個選擇。

在這我就簡而言之概括一下激光雷達的優點:激光雷達的探測距離和準確性都大大高於攝像頭,去年,通用汽車旗下自動駕駛技術公司 Cruise Automation的 CTO Kyle Vogt 曾表達過,激光雷達傳感器可帶來冗餘和重疊的功能,讓車輛即便面對最具挑戰性的環境,也能夠應對。

換句話來說,現在大多自動駕駛企業選擇激光雷達和計算機視覺結合的方案,為的就是留出安全冗餘。

不激進就不是特斯拉,在馬斯克看來,讓自動駕駛汽車頂著尺寸又大,同時造價需要數萬美元的激光雷達就是塑造一種虛假繁榮。不丟掉激光雷達這根柺杖,自動駕駛汽車就無法實現真正意義上的自動駕駛。

所以,現在以特斯拉為首,百度跟上步伐的純視覺派和其他大多數自動駕駛廠家選擇的激光雷達派,針對最先抵達自動駕駛的終極目標而陷入了不同的困境。純視覺派更像是等待“不成熟的技術變成熟”,激光雷達派則在等“好技術變得更便宜”。幾乎可以篤定地認為,誰最先走通自己的道路,到達自動駕駛這條偉大航路的終點,就在這場零和博弈中將對方徹底擠下船。

那麼特斯拉和百度

究竟是怎麼想的?

先說答案,特斯拉和百度考慮問題的終極目的,就是自動駕駛的商業化。

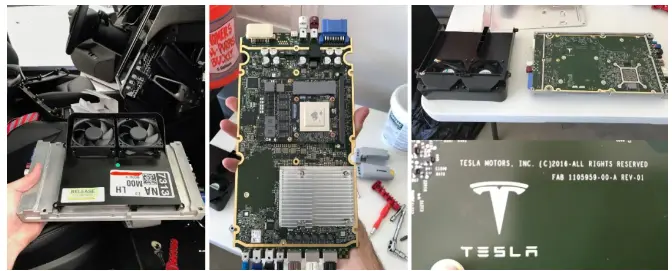

早在2016年,特斯拉在更新 Autopilot 2.0 硬件時,就使用了8 顆攝像頭,包括前置三目攝像頭(分別是長距窄視角、中距中視角和短距魚眼)、車輛的左右兩側各有 2 顆面向側前和側後的攝像頭,再加上 1 顆後置攝像頭,8 顆攝像頭完成了 360° 純視覺感知的無死角覆蓋。

但在其中非常有意思的是,匹配這套系統的核心芯片被改成了可插拔式設計,便於後期高性能芯片迭代之後的裝車。特斯拉的這個伏筆直到去年四月特斯拉FSD高算力芯片的量產,我們才有機會看到不久之前北美FSD自動駕駛Beta版的推送。

由此可見,特斯拉和百度所等待的,是算力和算法的提升。百度 Apollo 技術委員會主席王亮也曾表態過:攝像頭的圖像信息密度大、蘊含的環境信息最為豐富。但對人才、算法、數據、規模化機器學習的能力提出了很高的要求,需要強大的算法、大量數據的積累和長期的研發投入。

在這裡需要插播一條來自新華社的報道:僅北京一座城市就有 100 多家專門從事數據標註的公司,全國有超過 1000 萬人在從事數據標註工作——自動駕駛行業“數字富士康”實錘了。

訓練算法時的人工標註

而且更有意思的是,百度Apollo在此之前並非是純視覺路線的忠實擁躉。恰恰相反,百度一直堅持以激光雷達為主的多傳感器融合路線,但是為什麼會切換軌道,和特斯拉成為了戰友?

用王亮自己的話來解釋,就是在激光雷達為主,視覺為輔的傳統策略中,視覺感知自身的問題和缺陷在雷達感知的掩蓋下暴露不夠充分。因此,視覺感知問題需要獨立出來才能更好的解決。

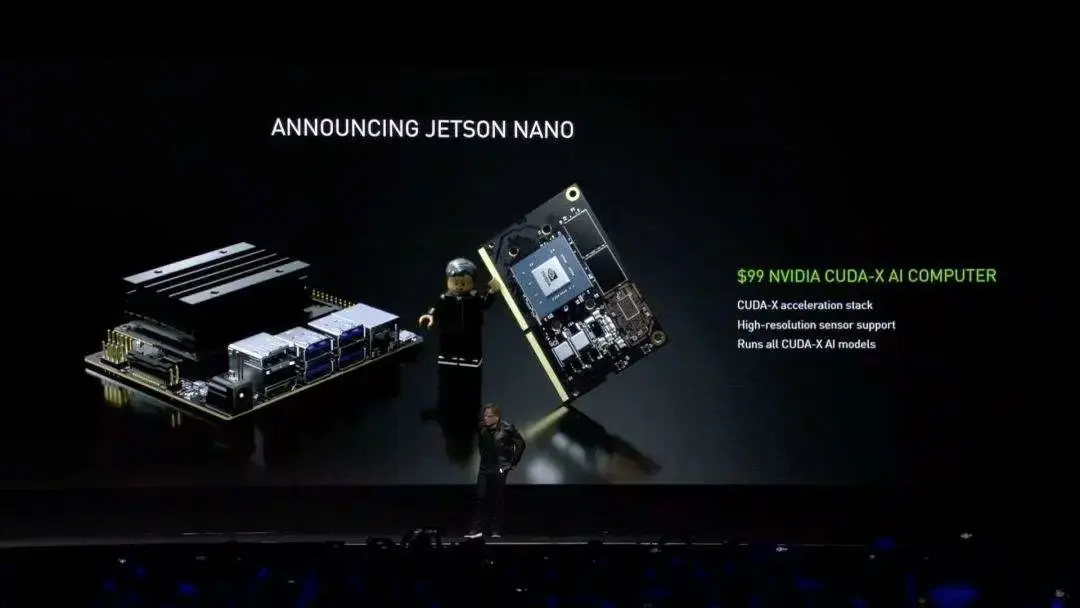

也許正是因為百度曾經深入瞭解過激光雷達的優點和短板之後,做出了選擇不同技術路線的決斷。而且算力的迭代也讓百度和特斯拉一樣,摸到了解決問題的鑰匙。在昨天的發佈會上,在算力層面,百度宣稱 Apollo Lite 所需算力不到 30 TOPs,一個單卡 GPU 即可驅動。

鄧小平曾經說過,中國式的現代化必須從中國的特點出發。這句話套用在百度身上同樣適用,畢竟作為自動駕駛的技術提供者,最終實現技術落地的並非百度自己,而是百度所服務的各家車企。以現在國內對於自動駕駛技術嗷嗷待哺的新能源企業,一個最通用、成本相對最合理的解決方案,必然是最符合國情的。而從最終裝車的成本和實現規範化的技術難度來說,純視覺路線似乎是最合適不過的。

這就非常有意思了。雖然在實現自動駕駛的路徑上,百度已經成為了特斯拉為數不多的隊友,但是到頭來在中國市場,特斯拉的這位“隊友”是要幫助特斯拉在中國市場上的各位對手來阻擊自己的。畢竟,特斯拉的技術只能為自己所用,而百度Apollo的方向則是“開源”,為加入自己技術體系的所有企業做技術後盾。

但是在如今激光雷達技術的成本愈發低廉的時代,純視覺路線是不是人類最終實現自動駕駛的唯一選擇,依然是個問號。到底誰才是過渡技術,誰又能在零和博弈中將其他對手全部掃下馬,現在依然是個未知數。

轉載請超鏈接註明:頭條資訊 » 百度和特斯拉走上同一條路,或成彼此最大對手

免責聲明

:非本網註明原創的信息,皆為程序自動獲取互聯網,目的在於傳遞更多信息,並不代表本網贊同其觀點和對其真實性負責;如此頁面有侵犯到您的權益,請給站長發送郵件,並提供相關證明(版權證明、身份證正反面、侵權鏈接),站長將在收到郵件24小時內刪除。