Connecting the Dots: 基于图神经网络的多元时间序列预测

题目:

Connecting the Dots: Multivariate Time Series Forecasting with Graph Neural Networks

作者:

Zonghan Wu, Shirui Pan, Guodong Long, Jing Jiang, Xiaojun Chang, Chengqi Zhang

来源:

Machine Learning

Accepted by KDD 2020

Submitted on 24 May 2020

关注人工智能学术前沿 回复 :ts01

5秒免费 获取论文pdf文档,及项目源码

摘要

多元时间序列建模一直是一个热门主题,吸引了来自不同领域的研究人员,包括经济、金融和交通。多元时间序列预测背后的一个基本假设是,其变量相互依赖,但仔细观察,可以说现有方法无法完全利用变量对之间的潜在空间依赖性。同时,近年来,图神经网络(GNN)在处理关系依赖方面表现出了很高的能力。GNN需要用于信息传播的定义明确的图结构,这意味着它们无法直接应用于事先不知道相关性的多元时间序列。在本文中,我们提出了一个专门为多元时间序列数据设计的通用图神经网络框架。我们的方法通过图形学习模块自动提取变量之间的单向关系,可以轻松地将诸如变量属性之类的外部知识整合到其中。进一步提出了一种新颖的混合跳跃传播层和一个扩张的起始层来捕获时间序列内的空间和时间依赖性。在端到端框架中共同学习图学习,图卷积和时间卷积模块。实验结果表明,我们提出的模型在4个基准数据集中的3个方面优于最新的基线方法,并在提供额外结构信息的两个交通数据集上与其他方法相比具有同等的性能。

英文原文

Modeling multivariate time series has long been a subject that has attracted researchers from a diverse range of fields including economics, finance, and traffic. A basic assumption behind multivariate time series forecasting is that its variables depend on one another but, upon looking closely, it is fair to say that existing methods fail to fully exploit latent spatial dependencies between pairs of variables. In recent years, meanwhile, graph neural networks (GNNs) have shown high capability in handling relational dependencies. GNNs require well-defined graph structures for information propagation which means they cannot be applied directly for multivariate time series where the dependencies are not known in advance. In this paper, we propose a general graph neural network framework designed specifically for multivariate time series data. Our approach automatically extracts the uni-directed relations among variables through a graph learning module, into which external knowledge like variable attributes can be easily integrated. A novel mix-hop propagation layer and a dilated inception layer are further proposed to capture the spatial and temporal dependencies within the time series. The graph learning, graph convolution, and temporal convolution modules are jointly learned in an end-to-end framework. Experimental results show that our proposed model outperforms the state-of-the-art baseline methods on 3 of 4 benchmark datasets and achieves on-par performance with other approaches on two traffic datasets which provide extra structural information.

基于图神经网络的多变量时间序列建模

引言

图是描述不同实体之间关系的数据的一种特殊形式。近年来,图神经网络由于其置换不变性、局部连通性和组合性,在处理图数据方面取得了很大的成功。通过通过结构传播信息,图神经网络允许图中的每个节点都知道它的邻域。

多元时间序列预测可以很自然地从图的角度来看待。多元时间序列中的变量可以看作是图中的节点,它们通过隐藏的依赖关系相互连接。因此,利用图神经网络对多变量时间序列数据进行建模是一种很有前途的方法,可以在充分利用时间序列之间的相关性的同时,保留多变量时间序列的时间轨迹。

最适合用于多变量时间序列的图神经网络类型是时空图神经网络。时空图神经网络以多元时间序列和外部图结构作为输入,预测多元时间序列的未来值或标签。与不利用结构信息的方法相比,时空图神经网络已经取得了显著的改进。

但是,由于存在以下问题,这些方法在建模多元时间序列时仍有不足之处:

挑战1:未知的图形结构。现有的GNN方法很大程度上依赖于预先雕花的图结构来进行时间序列预测。在大多数情况下,多元时间序列没有明确的图结构。变量之间的关系必须从数据中发现,而不是作为基本真理知识提供。

挑战2:图形学习与处理GNN学习。虽然有图结构,但大多数GNN方法只关注消息传递(GNN学习),忽略了图结构不是最优的,需要在训练时进行更新。接下来的问题是如何在端到端框架中同时学习时间序列的图结构和GNN。

本文工作总结

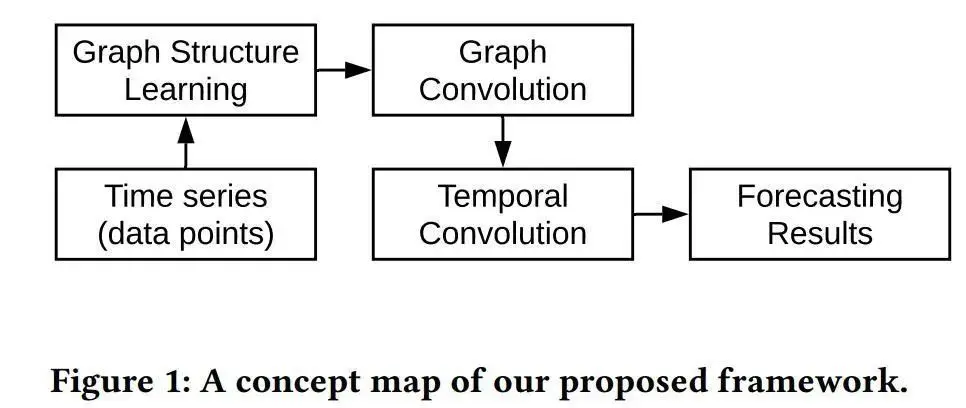

在本文中,我们提出了一种新的方法来克服这些挑战。如图1所示,我们的框架由三个核心组件组成:图学习层、图卷积模块和时序卷积模块。

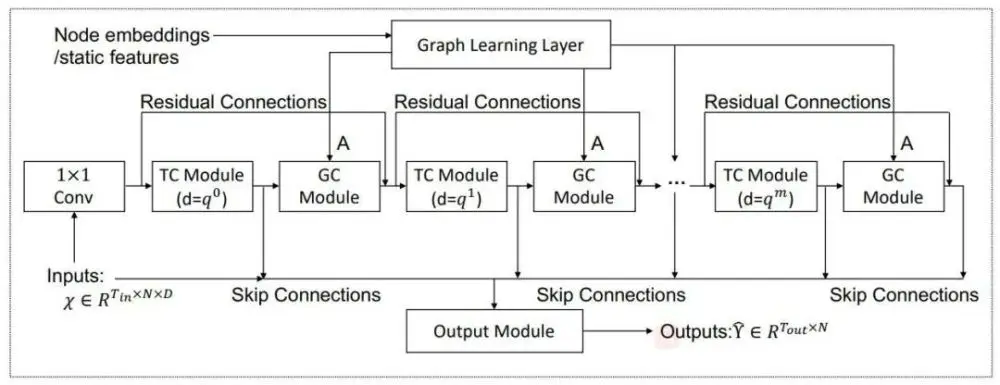

如图2所示,MTGNN的最高层由图学习层、m个图卷积模块、m个时序卷积模块和一个输出模块组成。为了发现节点之间隐藏的关联,图学习层计算一个图邻接矩阵,这个邻接矩阵后来被用作所有图卷积模块的输入。图形卷积模块与时间卷积模块相互交错,分别捕获空间和时间相关性。

本文主要贡献如下:

1.据我们所知,这是第一次使用图形神经网络从基于图形的角度对多变量时间序列数据进行研究。

2.我们提出了一个新的图学习模块来学习变量之间隐藏的空间依赖关系。该方法为GNN模型在处理数据时不需要明确的图结构打开了一扇新的大门。

3.我们提出了一个建模多元时间序列数据和学习图结构的联合框架。我们的框架比任何现有的时空图神经网络更通用,因为它可以处理多变量时间序列,无论是否使用预先修改过的图结构。

4.实验结果表明,我们的方法在4个基准数据集中的3个数据集上的性能优于现有的方法,并在两个提供额外结构信息的trafc数据集上达到与其他GNNs相同的性能。

实验结果

数据集

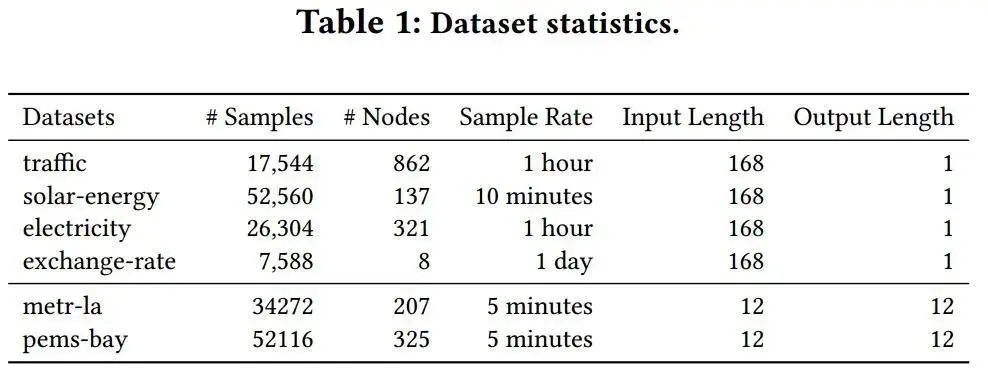

在表1中,我们总结了基准数据集的统计信息。

Electricity。UCI电力负荷图数据集包含370个客户的每小时总用电量,如[41]所示。根据[15],我们使用过去一周的数据(即168小时)来预测第二天(即24小时)的消耗量。

Traffic。2015年至2016年旧金山海湾地区高速公路862个传感器测量的道路占用率。UCI PEM-SF交通数据集描述了[41]中440条旧金山湾区高速公路的占用率(yt为[0,1])。根据电力数据集,它也按小时级别汇总,具有相同的后退窗口和预测范围。

Solar-Energy:国家可再生能源实验室的太阳能数据集包含了2007年阿拉巴马州137个光伏电站收集的太阳能输出

Exchange-Rate:汇率数据集包含了从1990年到2016年澳大利亚、英国、加拿大、瑞士、中国、日本、新西兰和新加坡等八个国家的每日汇率

模型

单步预测模型

1.AR"自回归模型。

2.VAR-MLP:多层感知的混合模型(MLP)和自回归模型(VAR)[25]。

3.GP:高斯过程时间序列模型[6,16]。

4.RNN-GRU:具有完全连接的递归神经网络GRU的单位。

5.LSTNet:深度神经网络,结合卷积神经网络和循环神经网络[12]。

6.TPA-LSTM:注意力循环神经网络[19]。

多步预测模型。

1.DCRNN:一种扩散卷积递归神经网络,它结合了扩散图卷积和递归神经网络[13]。

2.STGCN:一个时空图卷积网络,包含图卷积和一维卷积[23]。

3.Graph WaveNet:一种时空图卷积网络,将扩散图卷积与一维扩张卷积[21]融合在一起。。

4.ST-MetaNet:一个序列到序列的架构,使用元网络生成参数[15]。

5.GMAN:一个具有空间和时间注意的图形多注意网络。

实验结果分析

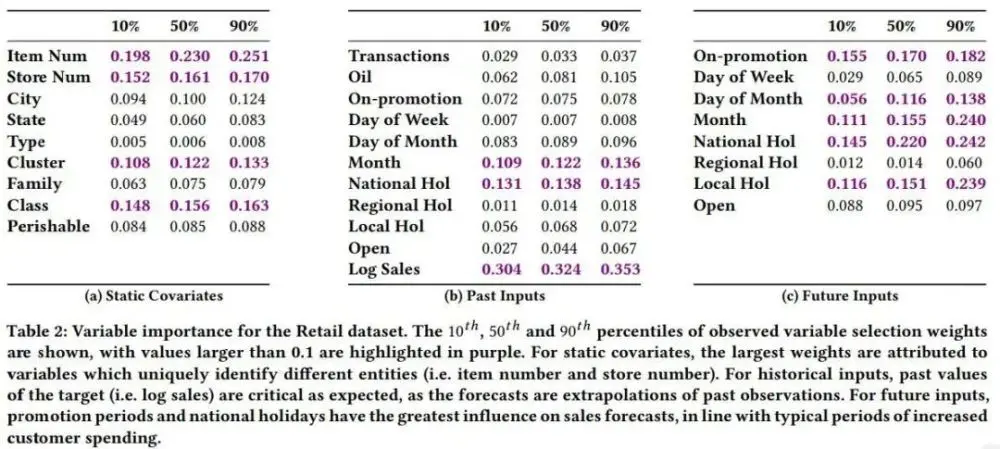

表2:多元时间序列单步预测的基线比较。

表3时空图神经网络多步预测的基线比较。

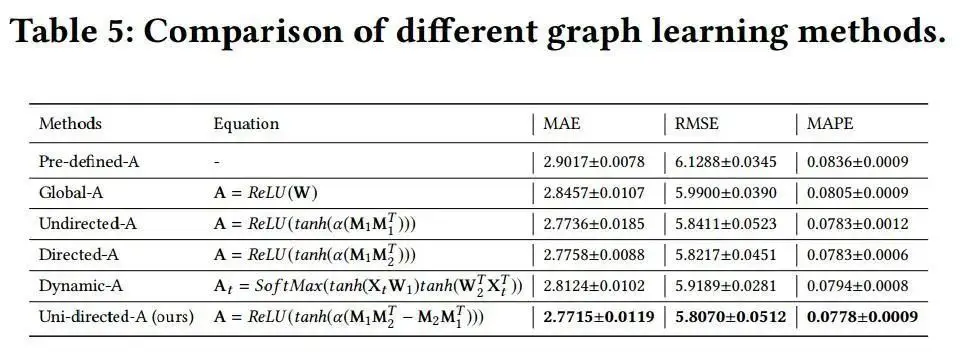

表5 不同图神经网络学习方法对比

结论

在本文中,我们介绍了用于多元时间序列预测的新颖框架。据我们所知,我们是第一个通过基于图的深度学习方法来解决多元时间序列预测问题的人。我们提出了一种有效的方法来利用多个时间序列之间的固有依赖关系。我们的方法在各种多元时间序列预测任务中展示了出色的性能,并为使用GNN处理各种非结构化数据打开了新的大门。

关注人工智能学术前沿 回复 :ts01

5秒免费 获取论文pdf文档,及项目源码

文字来源于网络 侵删

翻译:人工智能学术前沿

转载请超链接注明:头条资讯 » Connecting the Dots:基于图神经网络的多元时间序列预测

免责声明

:非本网注明原创的信息,皆为程序自动获取互联网,目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责;如此页面有侵犯到您的权益,请给站长发送邮件,并提供相关证明(版权证明、身份证正反面、侵权链接),站长将在收到邮件24小时内删除。