采写 | 何安安

如果我们创造出了达到或者超过人类智能水平的人工智能(AI),会发生什么?人类会成为自己发明的受害者吗?在不远抑或是遥远的未来,人类与机器人可以和平共处吗?人类有一天,会向机器人乞讨吗?在2017年,《纽约客》杂志的一幅封面画引发了一场有关于人类与机器人的大讨论。而今,由人工智能引发的争论正在变得比当时更多也更加激烈,这其中既有技术的纷争,也充斥着伦理和法律的博弈。

《纽约客》杂志封面画(2017年10月)。基库·约翰逊(R. Kikuo Johnson)绘。插图对应的封面文章名为《黑暗工厂》(Dark Factory),描述了密歇根州大急流城Steelcase金属厂中一些被称作“人肉机器人”的工人的故事,在这家公司,越来越多原本由人类从事的工作都被机器人取代。在这幅由基库·约翰逊(R. Kikuo Johnson)绘制的封面画中,年轻的人类乞丐坐在未来的曼哈顿街头乞讨,路上穿过的形形色色的机器人“上班族”和“行人”则向他手中的杯子里投掷着螺丝和垫片,他身旁的小狗也“目瞪口呆”地注视着面前通过的机器狗。

不可否认的是,人工智能正在成为日常生活的一部分——虽然它在即将过去的2020年并未取得重大突破,但显然,它已经切实改变了每一个人的生活。对于熟悉科幻小说、影视作品的人们来说,其中虚构的未来,可能正是我们所身处的现在。人工智能生态系统、无人驾驶汽车、智能个人助理、家用机器人……蓬勃发展的人工智能通过智能手机、家电、汽车等终端深入家庭、企业和各种公共设施,它是当下的普遍现象,更是未来的主导技术。

在人类尚未进入技术时代开始,有关机器人的想象就大量存在于文学和戏剧、影视作品之中。起初,人们担心人工智能会背叛人类——机器会因为更加聪明(智能)而反抗人类,甚至消灭人类。

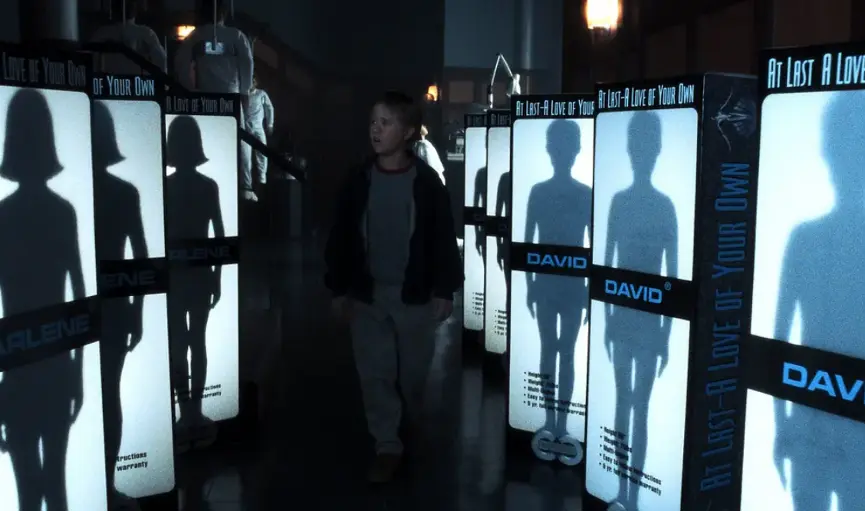

比如在根据科幻大师阿西莫夫短篇小说改编的电影《我,机器人》中所探讨的正是人与机器之间的关系。影片中,机器人具备了自我进化的能力,它们随时会转化成整个人类的“机械公敌”。而“终结者”系列,探讨的同样是机器人毁灭人类。为人工智能赋予人类的感情,衍生的又是一个全新的故事。史蒂文·斯皮尔伯格导演的《人工智能》中,机器人小孩大卫试图寻找自己的生存价值:渴望变成真正的小孩。

这些故事塑造了我们对人工智能的认知,阿西莫夫创作的“机器人三大定律”也因为这些作品的一再表述而成为我们看待机器人的“标准”信条。但在斯图尔特·罗素(Stuart Russell)看来,这或许反而成为了人类的某种误区,比如让人工智能“服从人类”显然就是个坏主意。

斯图尔特·罗素(Stuart Russell)(版权:Peg Skorpinski),加州大学伯克利分校计算机科学家,人类兼容人工智能中心(CHAI)主任,人工智能研究实验室指导委员会(BAIR)成员。世界经济论坛人工智能和机器人委员会副主席,美国科学促进会(AAAS)会士,美国人工智能协会(AAAI)会士。罗素获得过多项科学荣誉,包括美国国家科学基金会总统青年研究员奖、国际人工智能联合会议(IJCAI)计算机与思想奖、国际计算机学会(ACM)卡尔斯特朗杰出教育家奖等,并受邀在TED、世界经济论坛演讲。

一个极端的案例是,如果人类赋予机器人一个错误的或者存在漏洞的目标,这可能是致命的。假如我们希望通过人工智能系统控制气候变化,并为其设定将大气中的二氧化碳水平恢复到工业革命前水平的命令,这一系统很可能会得出消灭人类的结论——因为人类活动是产生二氧化碳最主要的来源。即便人类为此附加条件不能消灭人类,人工智能系统也可以会以说服的方式让人类少生孩子,直到人类自然灭绝。

身为美国加州大学伯克利分校计算机科学家的斯图尔特·罗素,是当今世界上人工智能领域的权威专家,他曾与谷歌研究总监彼得·诺维格合著出版了人工智能领域里的“标准教科书”《人工智能》,该书被128个国家的1400多所大学使用。就在今年二月,他已经完成了该书的第四版。

今年十月,斯图尔特·罗素的著作《AI新生:破解人机共存密码——人类最后一个大问题》引进出版,在这本书中,罗素提出了一个问题:如何破解人机共存的密码,使得人类可以掌握比我们自身强大得多的智能?在过去相当长的一段时间里,人类之所以能控制地球,是因为人类的大脑比其他动物的大脑要复杂得多。而这正是因为“智能”,是一种权利。因此,罗素更为关注的,是对于这些比我们更强大的机器,如何保持绝对的控制权?在新京报记者对罗素的采访中,他回答了一些关于人工智能我们所关心,或者未知的问题。

《AI新生:破解人机共存密码——人类最后一个大问题》,[美]斯图尔特·罗素(Stuart Russell)著,张羿译,中信出版社2020年10月版。

超级人工智能的成功可能意味着人类的毁灭

新京报: 是什么促使了你创作《AI新生》?最想告诉读者什么?

斯图尔特·罗素:我写作的核心目的是如何理解“控制”的问题——如何永远控制比我们强大的机器,并为此提出一个切实可行的解决方案。我希望可以获得帮助,改变这一领域的现状——让政府、工业界和学术界合作并非易事。

新京报:我们应该对人工智能持以什么样的态度?在许多科幻小说中,我们看到人工智能对人类的抵抗,这种抵抗来自于它们开始有自我意识,但你认为我们应该更担心它们的能力——这显然是人类赋予他们的。我们应该如何理解它?对于人工智能时代的到来,显然大多数人充满了期待和恐惧。

斯图尔特·罗素:目前对人工智能的思考方式,我将其称之为“标准模型”。也就是说,我们赋予机器以最佳方式去实现目标的能力,然后给予它们一个目标,它们开始运行。当定义了一个错误目标时,就会出现问题,现实情况中总会出现这样的状况。在许多文化中,都有着类似的传说:一个人被赐予三个愿望,而第三个愿望,总是会推翻前两个愿望——因为它们毁掉了一切。

来自机器人的“阻力”并非来自意识,而是机器人会追求我们所赋予它们的目标,而这可能会与我们真正想要达成的目标产生冲突。我们当然可以试着停止机器,或者彻底关闭它。但是,如果它们比我们更加聪明,这也许会成为一个不可能完成的任务。

如果我们编写了一个智能程序,它的行为方式就会完全由代码决定,这个时候,人工智能是否有意识,对于即将发生的事情并不会产生任何影响。当然,我们也完全不知道如何去制造一个拥有自主意识的人工智能,也不可能知道我们是否已经制造了一个。

人们之所以会关注(偶然)创造意识,主要原因是因为拥有自我意识的机器也许应该拥有一些特权,而这将使人工智能研究者以及其他人的生活变得非常复杂。想象一下这样的场景,你的烤面包机正在与冰箱进行着关于生命意义的精彩对话时,你拔下了它们的插头,然后因此被送进了监狱。

电影《人工智能》剧照。故事发生于21世纪中期,由于温室效应,南北极冰川融化,地球上很多城市被淹没,人工智能机器人就是人类发明出来用以应对恶劣自然环境的科技手段之一。在影片的设定中,机器人制造技术已经高度发达,先进的机器人不但拥有可以乱真的人类外表,还能感知自身的存在。

新京报:我们到底应该如何理解“人工智能”这一概念?在《AI新生》中你提到,超级人工智能的成功可能意味着人类的毁灭。

斯图尔特·罗素:粗略地讲,如果一个实体是智能的,它就会根据它的感知来做事情,而它所做的事情是为了满足它的需求。我们可以用一种很自然的方式来理解它的含义:“智能”意味着以一种可以预期的方式来实现一个人的目标的能力。智能包括了多种能力:比如推理、学习和交流能力,都可以理解为对这种能力的贡献。

对于人类而言,智能是一种非常好的能力。不幸的是,“人工智能”这一概念的框架形成于上世纪四五十年代间,而这也成为我们今天对人工智能的理解。这也正是我在前面所提到的“标准模型”。当然,机器本身并没有自己的目标,这些目标都来自于人类的设定。如果我们设定了错误的目标,就会导致失败。

如果你仔细思考一下,就会发现,创建一个可以自主追求并设定固定目标的机器是没有意义的——制造出能够实现自己目标的机器就更没有意义了!我们应该制造那些只能够帮助人类实现目标的机器,即使它们并不能理解这些目标到底是什么。

人工智能很快就可以创作出具有创造性和吸引力的作品

新京报:人工智能究竟会如何改变我们的未来是一个非常热门的话题。如果我们制造出比人类更为智能的机器,将会发生什么?你心目中的人工智能时代是什么样的?

斯图尔特·罗素:如果可以成功创建出那些安全、有益的人工智能系统,我们将会获得几乎难以想象的好处,这些好处来自于运用更为强大的智能来推进人类文明的能力。我们将从数千年来,作为农业、工业和文书工作的奴役中解放出来,能够自由、充分地发挥和利用生活最大的潜力。站在这个黄金时代的有利位置上,回顾我们当下的生活,可能正如托马斯·霍布斯(Thomas Hobbes)所想象的那样:充满着孤独、贫穷、肮脏、野蛮和短暂。

电影《2001太空漫游》(1968)剧照。故事设定开始于2001年,为了寻找黑石的根源,人类开展一项木星登陆计划。飞船上有冬眠的三名宇航员,大卫船长、富兰克飞行员,还有一部叫“HAL9000”(赫尔)的高智能电脑。

具体来说,这样的人工智能系统,可以让我们把地球上每一个人的生活水平都提升到一个像样且体面的程度;每一个人都可以获得一位私人导师来指导他们的成长;每一个在目前看来昂贵、困难、进展缓慢甚至(在世界某些地区)无法得以实施的社区项目都会变得可行。

新京报:现在呢?对于你个人而言,人工智能的应运,对你的生活带来了哪些改变?

斯图尔特·罗素:在我的日常生活中,人工智能提供了即时、免费且高质量的翻译。我因此可以阅读出版商用中文发来的文件,我也经常阅读法国政府寄来的法律和税务文件(不幸的是,我也看不懂他们发来的英文)。和数十亿人一样。我每天都要使用搜索引擎(它们大多由人工智能驱动)来寻找那些过去被深藏于图书馆或百科全书中,或者根本得不到的信息。那些在过去缓慢、昂贵或难以访问的东西,正在变得即时、免费、唾手可得。而这正是现如今人工智能为我们生活带来的改变——这不仅仅是信息服务,还包括了各种商品和其他服务。

新京报:如果一台机器通晓人类所有语言,且能够以一种迅速而强大的方式获取人类知识(尽管在你看来这不太可能),普通人阅读和学习还有意义吗?人工智能是否会颠覆人类获取知识的方式?

斯图尔特·罗素:如果一个机器人可以快速的吃掉冰淇淋,是否意味着人类将停止吃冰淇淋?并不会!我们阅读,是为了娱乐和学习。显然,我们将继续这样做。当然,人工智能可以帮助我们去阅读那些我们难以独立完成阅读的书籍和资料。

电影《机械姬》(2014)剧照。影片中,天才一般的纳森研制了具有独立思考能力的智能机器人伊娃,为了确认她是否具有独立思考的能力,他希望加利能为伊娃进行著名的“图灵测试”。似乎从第一眼开始,加利便为这台有着宛如人类般姣好容颜的机器人所吸引。

新京报:人工智能将来有可能取代作家吗?尽管一些人可能不这么认为。

斯图尔特·罗素:是的,人工智能正在取代创作者,特别是对于新闻而言。这种现象将会变得越来越普遍,而且,这会很快。目前,许多文章的原始资料已经可以在网上轻易获取,人工智能只需要收集和整理这些信息,并以某种可读的方式将它们呈现出来。目前,人工智能还不能准确处理人类、社会、政治、国际关系方面的内容——这种情况当然会得到改变,但还需要很长一段时间。

不过,我认为,人工智能很快就可以通过阅读数以百万计的书籍,并将其中的一些元素进行重新编织,形成新颖的组合,从而创作出具有创造性和吸引力的作品。

让人工智能“服从人类”是个坏主意

新京报:你曾经提出了人工智能的三个新原则:而这显然和阿西莫夫定律背道而驰,你为什么会做出如此修改呢?

斯图尔特·罗素:这三个原则如下:1、利他主义(Altruism)——机器的唯一目标是最大限度地实现人类的偏好;2、谦逊原则(humility)——机器最初并不确定人类的偏好是什么,这是创建有益机器的关键;3、学习预测人类偏好,人类偏好的最终信息来源是人类行为。

阿西莫夫(Asimov)设计他的三定律(不伤害人类、服从人类、保护自我)是为了创造有趣的情节,而不是为了保护人类免受机器人的伤害。“不伤害人类”的原则与我的第一条原则相似,只是阿西莫夫认为“伤害”有一个固定的定义——而这正是我试图避免的。

出于同样的原因,“服从人类”也是个坏主意,尤其是当这个人类是一个脾气暴躁的两岁儿童时。他的机器人“保护自我”原则是完全没有必要的,因为如果机器人的继续存在对人类有帮助的话,它会自动做到这一点。而且,正如它应该做的那样,《星际穿越》中的TARS机器人也应该为了拯救人类而快乐地自杀。

电影《星际穿越》(2014)剧照。右侧方形物体为TARS机器人。

有几种情况可能会误解这些原则。最为常见的是人们认为我是在建议把一套人类的价值观插入机器,例如基督教价值观或儒家价值观。没有这回事。机器应该为每个活着的人设置一个单独的偏好模型,这个模型是基于人类的偏好(其中大部分是机器并不知道的)。同样重要的是,要明白机器不会把这些偏好当成自己的,它只是在学习人类想要什么。它也学不会像人类一样行事,就像犯罪学家不会学着像罪犯一样行事。这台机器完全是利他主义的,没有自己的偏好。

最为困难的问题来自于专业的哲学家,他们已经为此思考了几千年。有些人会问:人类的偏好是不稳定的,是可以被操纵的,我同意这是上述三个原则的一个问题。其他人则问,偏好——我们希望未来如何——是否真的可以作为在道德上站得住的决定的基础,以及我们是否也需要考虑权利。令人担忧的是,许多人的偏好可能会侵犯个人的权利。关于这一主题的书籍已经有成千上万了,因此我不会在这里提出自己的意见,只想说我相信对立的观点实际上也是可以调和的。

电影《黑客帝国》(1999)剧照。片中,网络黑客尼奥对这个看似正常的现实世界产生了怀疑。他结识了黑客崔妮蒂,并见到了黑客组织的首领墨菲斯。墨菲斯告诉他,现实世界其实是由一个名叫“母体”的计算机人工智能系统控制,人们就像他们饲养的动物,没有自由和思想,而尼奥就是能够拯救人类的救世主。

今年春天,我和两位哲学家,一位经济学家一起上了一堂课,研究了一些难题,即机器做出的决策对人类有益到底意味着什么,尤其是当我们考虑到有许多人有着不同的偏好时。这些问题在道德哲学和政治理论中已经提出了很长时间,但我们需要尽快回答它们!否则我们的人工智能系统就会遵循非常错误的理论。我觉得这很有趣,我很确定我们能取得一些进展。

新京报:那么,你会如何看待有关于人工智能的科幻小说或者影视作品呢?

斯图尔特·罗素:我小时候读过很多科幻小说,最近几年,我又开始和孩子们一起阅读。现在,我正和二儿子乔治一起看刘慈欣的《三体》三部曲,和小儿子艾萨克一起看《星际迷航》。我一直在寻找那些描绘人类与超级智能愉快共存并拥有美好未来的作品。这样的作品不是很多。比如伊恩·班克斯(Iain Banks)的“文明”系列,在他的构想中,未来的人工智能系统比人类的能力要强大得多,但它们(以某种方式)被设计成几乎完全有利于人类。他无法回答的一个明显问题是,当机器完美地运行一切时,人类能在生活中找到什么目的。他们有大量的闲暇时间和无限的物质资源,但缺乏明确的目的,人们拼命地竞争极少数可以提供真正挑战的职位。

电影《星际迷航》(2009)剧照。

像大多数人工智能研究人员一样,我相当有信心我们将实现达到人类水平的人工智能,尽管这可能不会像许多人认为的那样快。我们仍然需要克服一些巨大的概念性挑战,很难说这需要花费多长时间。

机器必然会后退一步,为人类留下可成长的空间

新京报:在新款Neuralink脑机接口芯片的发布仪式上,埃隆·马斯克说,人们将能够通过BCI召唤他们的特斯拉。你也曾经提到过一种极端情况:人机一体化,电子硬件直接连接到大脑,成为单一的、可扩展的、有意识的实体的一部分。我们应该如何看待人类与人工智能之间的共生机制?

斯图尔特·罗素:人脑能够向设备发出命令是一回事,比如现在瘫痪的人可以使用机器手臂。但当我们试图通过电子设备,增强大脑的思维过程时,这件事就截然不同了。如果每个人都必须接受脑外科手术才能够上学,这难道不是我们犯了一个大错?

新京报:数字永生呢?

斯图尔特·罗素:到目前为止,将我们大脑中的全部思想和记忆上传到计算机中仍然是一个推测。我们并没有理论可以解释为什么人类的意识、体验可以存在,因此,我们也无法确定将思想和记忆的结构、状态复制到计算机中,我们仍然可以存在。苏珊·施耐德(Susan Schneider)撰写的《人造的你》(Artificial You)一书对这个问题进行了广泛的讨论。

《人造的你》(Artificial You),苏珊·施耐德(Susan Schneider著,普林斯顿大学出版社(Princeton University Press)2019年9月版。

新京报:滥用人工智能的可怕后果是什么?很明显,这一部分的某些东西会让人非常沮丧。

斯图尔特·罗素:就像任何技术一样,人工智能也可能被滥用。以下是几种可能的情况:用于监视、劝说和控制的人工智能可以极大地减少人们的自由。而且,人工智能可以产生和传播虚假信息,并且模仿人类,使得人们很难知道什么是真的。

用于杀人的人工智能自主武器是致命的,很容易变成大规模杀伤性武器,因为人工智能武器不需要人类来监督,而且可以成百万计的发射。人工智能最终可能取代大多数人类工作——如果我们不能迅速调整社会和教育系统,让人们得以适应一个完全不同的世界——这将引发巨大的问题。

新京报:随着人工智能时代的到来,我们的文明会终结吗?当我们把所有的知识都投入到机器中,让机器来管理我们的文明,人类的惰性很可能导致这种结果。如何避免这种结果?

斯图尔特·罗素:这里有两个问题。首先,我们能否确保超级智能人工智能系统是安全和有益的?我认为答案是肯定的。第二,当人类文明由机器在运转时,还能保持它的活力吗?尼克·博斯特罗姆(Nick Bostrom)在他的《超级智能》(Superintelligence)一书中说,第一个问题是“我们这个时代的基本任务”,但是如果我们回答了第一个问题,那么第二个问题就成了我们这个时代以及所有未来时代的根本任务。

《超级智能》(Superintelligence),尼克·博斯特罗姆(Nick Bostrom)著,Oxford University Press2014年9月版。

我们应该从哪里找到目标,无论是个人的还是集体的?也许人工智能会来拯救我们,因为目标和挑战是人类生活的重要组成部分,它们的消失显然不是我们希望看到的未来。因此,可以说,机器必然会后退一步,为人类留下可成长的空间。

采写 | 何安安

编辑 | 王青

校对 | 陈荻雁

转载请超链接注明:头条资讯 » 创造出超越人类智能的人工智能会发生什么?丨专访斯图尔特·罗素

免责声明

:非本网注明原创的信息,皆为程序自动获取互联网,目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责;如此页面有侵犯到您的权益,请给站长发送邮件,并提供相关证明(版权证明、身份证正反面、侵权链接),站长将在收到邮件24小时内删除。