在我们日常的浏览网页和看各种视频或者短视频的时候,我们能够明显的发现,那些低俗的视频和图片突然就不见了。反之,网络上正能量篇幅越来越多,这对于青少年的发展起到了很大的正向引导作用。我们也要去想,到底是谁在幕后做了这么多好事呢?

其实这一切的功劳,多半是来自于腾讯AI人工智能系统,他们能够准确的判断不良信息并且能够反馈到系统,并且引导企业将其删除或者做其他的处理。通过对算法模型的不断优化,他们每天处理1亿甚至10亿条不良信息。这样一来,鉴黄师就有了足够的时间去过正常的生活,比如说锻炼身体和休闲娱乐。所以说,大家不必担心他们的身体健康问题,腾讯某高管表示:一口气做15个俯卧撑轻轻松松!

从文字到图片再到直播和短视频,这些都是让平台、企业头疼不已的不良内容,腾讯AI人工智能都能将其轻松识别,并且能及时反馈给自己的leader!

当然了,AI人工智能不能一开始就那么的聪明,这是需要经历人工标注+机器学习的反复过程。总体而言,我们所谓的鉴黄师,其实只是AI智能系统的“训导员”罢了!这样看来,想要和AI去拼速度,人工肯定是没有任何优势的。当然了,除了腾讯AI人工智能挑选之外,腾讯安全人员也会定期的抽检几十万条数据,来检验AI人工智能的准确率

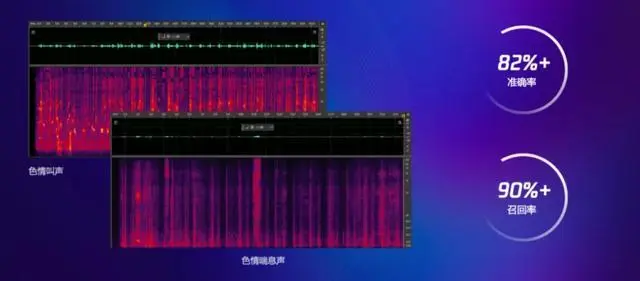

除了单纯的图文视频和直播之外,其实色情音频也是一个不可忽视的点,也就是把鉴黄做的更加全面立体,不让任何的黄色进入用户的视野。比如说视频中的音频,或者是单纯的音频,都要仔细的分析到位。即便是一段正常的视频,但视频对白中有明显的“娇喘呻吟”,鉴黄师同样可以帮助AI人工智能做出识别和阻断。

训练过程同时是相当繁重的,对此,腾讯的鉴黄师团队积累了长达1000小时的色情音频,并为不同的场景做出不同的识别和阻断处理。

目前,腾讯安全天御内容风控团队的这套覆盖文本、图像、视频、语音的AI及大数据算法模型,已经通过腾讯云和微信小程序,服务超过5万家开发者,行业渗透率高达90%,将行业的平均内容审核效率拉升了20倍以上,大大降低了人工审核的成本,守护了数万家客户的内容安全。

志鸿骄傲的说道!“成年人的世界里没有‘容易’二字,净化‘成人世界’更是不容易,但我们会一直坚持下去。”

转载请超链接注明:头条资讯 » 每天处理1亿条色情图片,收集1000h色情音频,鉴黄师突然火热

免责声明

:非本网注明原创的信息,皆为程序自动获取互联网,目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责;如此页面有侵犯到您的权益,请给站长发送邮件,并提供相关证明(版权证明、身份证正反面、侵权链接),站长将在收到邮件24小时内删除。